-

Bereitstellen einer NetScaler ADC VPX- Instanz

-

Optimieren der Leistung von NetScaler ADC VPX auf VMware ESX, Linux KVM und Citrix Hypervisors

-

Installieren einer NetScaler ADC VPX Instanz auf einem Bare-Metal-Server

-

Installieren einer NetScaler ADC VPX-Instanz auf Citrix Hypervisor

-

Installieren einer NetScaler ADC VPX-Instanz in der VMware Cloud auf AWS

-

Installieren einer NetScaler ADC VPX-Instanz auf Microsoft Hyper-V-Servern

-

Installieren einer NetScaler ADC VPX-Instanz auf der Linux-KVM-Plattform

-

Bereitstellen einer NetScaler ADC VPX-Instanz auf AWS

-

Bereitstellen einer eigenständigen NetScaler ADC VPX-Instanz auf AWS

-

Bereitstellen eines VPX-HA-Paar in derselben AWS-Verfügbarkeitszone

-

Bereitstellen eines VPX Hochverfügbarkeitspaars mit privaten IP-Adressen in verschiedenen AWS-Zonen

-

Bereitstellen einer NetScaler ADC VPX-Instanz auf AWS Outposts

-

Konfigurieren einer NetScaler ADC VPX-Instanz für die Verwendung der SR-IOV-Netzwerkschnittstelle

-

Konfigurieren einer NetScaler ADC VPX-Instanz für die Verwendung von Enhanced Networking mit AWS ENA

-

Bereitstellen einer NetScaler ADC VPX-Instanz auf Microsoft Azure

-

Netzwerkarchitektur für NetScaler ADC VPX-Instanzen auf Microsoft Azure

-

Mehrere IP-Adressen für eine eigenständige NetScaler ADC VPX-Instanz konfigurieren

-

Hochverfügbarkeitssetup mit mehreren IP-Adressen und NICs konfigurieren

-

Hochverfügbarkeitssetup mit mehreren IP-Adressen und NICs über PowerShell-Befehle konfigurieren

-

NetScaler ADC VPX-Instanz für beschleunigte Azure-Netzwerke konfigurieren

-

HA-INC-Knoten über die Citrix Hochverfügbarkeitsvorlage mit Azure ILB konfigurieren

-

NetScaler ADC VPX-Instanz auf der Azure VMware-Lösung installieren

-

Konfigurieren von GSLB in einem Active-Standby-Hochverfügbarkeitssetup

-

Konfigurieren von Adresspools (IIP) für eine NetScaler Gateway Appliance

-

NetScaler ADC VPX-Instanz auf der Google Cloud Platform bereitstellen

-

Bereitstellung und Konfigurationen von NetScaler ADC automatisieren

-

Lösungen für Telekommunikationsdienstleister

-

Authentifizierung, Autorisierung und Überwachung des Anwendungsverkehrs

-

Wie Authentifizierung, Autorisierung und Auditing funktionieren

-

Grundkomponenten der Authentifizierung, Autorisierung und Audit-Konfiguration

-

Lokal NetScaler Gateway als Identitätsanbieter für Citrix Cloud

-

Authentifizierungs-, Autorisierungs- und Überwachungskonfiguration für häufig verwendete Protokolle

-

-

-

-

Konfigurieren von erweiterten Richtlinienausdrücken: Erste Schritte

-

Erweiterte Richtlinienausdrücke: Arbeiten mit Datumsangaben, Zeiten und Zahlen

-

Erweiterte Richtlinienausdrücke: Analysieren von HTTP-, TCP- und UDP-Daten

-

Erweiterte Richtlinienausdrücke: Analysieren von SSL-Zertifikaten

-

Erweiterte Richtlinienausdrücke: IP- und MAC-Adressen, Durchsatz, VLAN-IDs

-

Erweiterte Richtlinienausdrücke: Stream-Analytics-Funktionen

-

Zusammenfassende Beispiele für Standardsyntaxausdrücke und -richtlinien

-

Tutorial Beispiele für Standardsyntaxrichtlinien für Rewrite

-

Migration von Apache mod_rewrite-Regeln auf die Standardsyntax

-

-

-

-

-

-

-

-

Verwalten eines virtuellen Cache-Umleitungsservers

-

Statistiken für virtuelle Server zur Cache-Umleitung anzeigen

-

Aktivieren oder Deaktivieren eines virtuellen Cache-Umleitungsservers

-

Direkte Richtlinieneinschläge auf den Cache anstelle des Ursprungs

-

Verwalten von Clientverbindungen für einen virtuellen Server

-

Externe TCP-Integritätsprüfung für virtuelle UDP-Server aktivieren

-

-

Übersetzen die Ziel-IP-Adresse einer Anfrage in die Ursprungs-IP-Adresse

-

-

Unterstützung für NetScaler ADC-Konfiguration in einem Cluster

-

Verwalten des NetScaler ADC Clusters

-

Knotengruppen für gepunktete und teilweise gestreifte Konfigurationen

-

Entfernen eines Knotens aus einem Cluster, der mit Cluster-Link-Aggregation bereitgestellt wird

-

Überwachen von Fehlern bei der Befehlsausbreitung in einer Clusterbereitstellung

-

VRRP-Interface-Bindung in einem aktiven Cluster mit einem einzigen Knoten

-

-

-

Konfigurieren von NetScaler ADC als nicht-validierenden sicherheitsbewussten Stub-Resolver

-

Jumbo-Frames Unterstützung für DNS zur Handhabung von Reaktionen großer Größen

-

Zwischenspeichern von EDNS0-Client-Subnetzdaten bei einer NetScaler ADC-Appliance im Proxymodus

-

-

GSLB-Entitäten einzeln konfigurieren

-

Anwendungsfall: Bereitstellung einer Domänennamen-basierten Autoscale-Dienstgruppe

-

Anwendungsfall: Bereitstellung einer IP-Adressbasierten Autoscale-Dienstgruppe

-

-

-

IP-Adresse und Port eines virtuellen Servers in den Request-Header einfügen

-

Angegebene Quell-IP für die Back-End-Kommunikation verwenden

-

Quellport aus einem bestimmten Portbereich für die Back-End-Kommunikation verwenden

-

Quell-IP-Persistenz für Back-End-Kommunikation konfigurieren

-

Lokale IPv6-Linkadressen auf der Serverseite eines Load Balancing-Setups

-

Erweiterte Load Balancing-Einstellungen

-

Allmählich die Belastung eines neuen Dienstes mit virtuellem Server-Level erhöhen

-

Anwendungen vor Verkehrsspitzen auf geschützten Servern schützen

-

Bereinigung von virtuellen Server- und Dienstverbindungen ermöglichen

-

Persistenzsitzung auf TROFS-Diensten aktivieren oder deaktivieren

-

Externe TCP-Integritätsprüfung für virtuelle UDP-Server aktivieren

-

Standortdetails von der Benutzer-IP-Adresse mit der Geolocation-Datenbank abrufen

-

Quell-IP-Adresse des Clients beim Verbinden mit dem Server verwenden

-

Limit für die Anzahl der Anfragen pro Verbindung zum Server festlegen

-

Festlegen eines Schwellenwerts für die an einen Dienst gebundenen Monitore

-

Grenzwert für die Bandbreitenauslastung durch Clients festlegen

-

-

-

Lastausgleichs für häufig verwendete Protokolle konfigurieren

-

Anwendungsfall 5: DSR-Modus beim Verwenden von TOS konfigurieren

-

Anwendungsfall 6: Lastausgleich im DSR-Modus für IPv6-Netzwerke mit dem TOS-Feld konfigurieren

-

Anwendungsfall 7: Konfiguration des Lastenausgleichs im DSR-Modus mithilfe von IP Over IP

-

Anwendungsfall 8: Lastausgleich im Einarmmodus konfigurieren

-

Anwendungsfall 9: Lastausgleich im Inlinemodus konfigurieren

-

Anwendungsfall 10: Lastausgleich von Intrusion-Detection-System-Servern

-

Anwendungsfall 11: Netzwerkverkehr mit Listenrichtlinien isolieren

-

Anwendungsfall 12: Citrix Virtual Desktops für den Lastausgleich konfigurieren

-

Anwendungsfall 13: Citrix Virtual Apps für den Lastausgleich konfigurieren

-

Anwendungsfall 14: ShareFile-Assistent zum Lastausgleich Citrix ShareFile

-

Anwendungsfall 15: Layer-4-Lastausgleich auf der NetScaler ADC-Appliance konfigurieren

-

SSL-Offload und Beschleunigung

-

Unterstützung des TLSv1.3-Protokolls wie in RFC 8446 definiert

-

Unterstützungsmatrix für Serverzertifikate auf der ADC-Appliance

-

Unterstützung für Intel Coleto SSL-Chip-basierte Plattformen

-

Unterstützung für Thales Luna Network Hardwaresicherheitsmodul

-

-

-

-

CloudBridge Connector-Tunnels zwischen zwei Rechenzentren konfigurieren

-

CloudBridge Connector zwischen Datacenter und AWS Cloud konfigurieren

-

CloudBridge Connector Tunnels zwischen einem Rechenzentrum und Azure Cloud konfigurieren

-

CloudBridge Connector Tunnels zwischen Datacenter und SoftLayer Enterprise Cloud konfigurieren

-

-

Konfigurationsdateien in einem Hochverfügbarkeitssetup synchronisieren

-

Hochverfügbarkeitsknoten in verschiedenen Subnetzen konfigurieren

-

Beschränken von Failovers, die durch Routenmonitore im Nicht-INC-Modus verursacht werden

-

HA-Heartbeat-Meldungen auf einer NetScaler ADC-Appliance verwalten

-

NetScaler ADC in einem Hochverfügbarkeitssetup entfernen und ersetzen

This content has been machine translated dynamically.

Dieser Inhalt ist eine maschinelle Übersetzung, die dynamisch erstellt wurde. (Haftungsausschluss)

Cet article a été traduit automatiquement de manière dynamique. (Clause de non responsabilité)

Este artículo lo ha traducido una máquina de forma dinámica. (Aviso legal)

此内容已经过机器动态翻译。 放弃

このコンテンツは動的に機械翻訳されています。免責事項

이 콘텐츠는 동적으로 기계 번역되었습니다. 책임 부인

Este texto foi traduzido automaticamente. (Aviso legal)

Questo contenuto è stato tradotto dinamicamente con traduzione automatica.(Esclusione di responsabilità))

This article has been machine translated.

Dieser Artikel wurde maschinell übersetzt. (Haftungsausschluss)

Ce article a été traduit automatiquement. (Clause de non responsabilité)

Este artículo ha sido traducido automáticamente. (Aviso legal)

この記事は機械翻訳されています.免責事項

이 기사는 기계 번역되었습니다.책임 부인

Este artigo foi traduzido automaticamente.(Aviso legal)

这篇文章已经过机器翻译.放弃

Questo articolo è stato tradotto automaticamente.(Esclusione di responsabilità))

Translation failed!

Schrittweise die Last eines neuen Dienstes mit langsamem Start auf virtueller Serverebene erhöhen

Sie können die Citrix ADC Appliance so konfigurieren, dass die Auslastung eines Dienstes (die Anzahl der Anforderungen, die der Dienst pro Sekunde erhält) schrittweise erhöht, nachdem der Dienst entweder zu einer Lastenausgleichskonfiguration hinzugefügt wurde oder eine Statusänderung von DOWN zu UP vorgenommen hat (in diesem Dokument lautet der Begriff “neuer Dienst” wird für beide Situationen verwendet). Sie können die Last entweder manuell mit Lastwerten und Intervallen Ihrer Wahl erhöhen (manueller langsamer Start) oder die Appliance so konfigurieren, dass sie die Last in einem bestimmten Intervall erhöht (automatischer langsamer Start), bis der Dienst so viele Anforderungen erhält wie die anderen Dienste in der Konfiguration. Während des Hochlaufzeitraums für den neuen Dienst verwendet die Appliance die konfigurierte Lastausgleichsmethode.

Diese Funktionalität ist nicht global verfügbar. Es muss für jeden virtuellen Server konfiguriert werden. Die Funktionalität ist nur für virtuelle Server verfügbar, die eine der folgenden Lastausgleichsmethoden verwenden:

- Round Robin

- Geringste Verbindung

- Geringste Reaktionszeit

- Geringste Bandbreite

- Am wenigsten Pakete

- LRTM (Methode der geringsten Antwortzeit)

- Benutzerdefiniertes Laden

Für diese Funktionalität müssen Sie die folgenden Parameter festlegen:

-

Die neue Serviceanforderungsrate, d. h. der Betrag, um den die Anzahl oder den Prozentsatz der Anforderungen erhöht werden, die bei jeder Erhöhung der Rate an einen neuen Dienst gesendet werden. Das heißt, Sie geben die Größe des Inkrements entweder in Bezug auf die Anzahl der Anforderungen pro Sekunde oder den Prozentsatz der Last an, die zu diesem Zeitpunkt von den vorhandenen Diensten getragen wird. Wenn dieser Wert auf 0 (Null) festgelegt ist, wird der langsame Start für neue Dienste nicht ausgeführt.

Hinweis: In einem automatisierten Langsamstartmodus ist das letzte Inkrement kleiner als der angegebene Wert, wenn der angegebene Wert den neuen Dienst stärker belasten würde als bei den anderen Diensten.

-

Das Inkrementintervall in Sekunden. Wenn dieser Wert auf 0 (Null) gesetzt ist, wird die Last nicht automatisch erhöht. Sie müssen es manuell erhöhen.

Bei einem automatisierten langsamen Start wird ein Dienst aus der langsamen Startphase herausgenommen, wenn eine der folgenden Bedingungen zutrifft:

- Die tatsächliche Anforderungsrate ist niedriger als die neue Serviceanforderungsrate.

- Der Dienst empfängt keinen Datenverkehr für drei aufeinanderfolgende Inkrementintervalle.

- Die Anforderungsrate wurde 200 Mal erhöht.

- Der Prozentsatz des Datenverkehrs, den der neue Dienst empfangen muss, ist größer oder gleich 100.

Beim manuellen langsamen Start bleibt der Dienst in der langsamen Startphase, bis Sie ihn aus dieser Phase herausnehmen.

Manueller langsamer Start

Wenn Sie die Last für einen neuen Dienst manuell erhöhen möchten, geben Sie kein Inkrementintervall für den virtuellen Lastausgleichsserver an. Geben Sie nur die neue Serviceanforderungsrate und die Einheiten an. Da kein Intervall angegeben ist, erhöht die Appliance die Last nicht periodisch. Es behält die Last auf den neuen Dienst mit dem Wert bei, der durch die Kombination aus der neuen Serviceanforderungsrate und Einheiten angegeben wird, bis Sie einen der Parameter manuell ändern. Wenn Sie beispielsweise die neue Serviceanforderungsrate und die Einheitsparameter auf 25 bzw. “pro Sekunde” festlegen, behält die Appliance die Last für den neuen Dienst bei 25 Anforderungen pro Sekunde bei, bis Sie einen der Parameter ändern. Wenn der neue Dienst den langsamen Startmodus beenden und so viele Anforderungen wie die vorhandenen Dienste empfangen soll, legen Sie den neuen Parameter für die Serviceanforderungsrate auf 0 fest.

Nehmen Sie beispielsweise an, dass Sie einen virtuellen Server zum Lastenausgleich 2 Dienste, Service1 und Service2, im Round-Robin-Modus verwenden. Ferner wird davon ausgegangen, dass der virtuelle Server 240 Anforderungen pro Sekunde empfängt und dass er die Last gleichmäßig über die Dienste verteilt. Wenn ein neuer Dienst, Service3, zur Konfiguration hinzugefügt wird, sollten Sie die Last auf ihn manuell durch Werte von 10, 20 und 40 Anforderungen pro Sekunde erhöhen, bevor Sie den vollen Anteil der Last senden. Die folgende Tabelle zeigt die Werte, auf die Sie die drei Parameter festlegen.

Tabelle 1. Parameterwerte

| Parameter | Wert |

|---|---|

| Intervall in Sekunden | 0 |

| Neue Serviceanforderungsrate | 10, 20, 40 und 0, in Intervallen, die Sie wählen |

| Einheiten für die neue Serviceanforderungsrate | Anfragen pro Sekunde |

Wenn Sie den neuen Service-Requestrate-Parameter auf 0 setzen, wird Service3 nicht mehr als neuer Dienst betrachtet und erhält seinen vollen Anteil der Last.

Angenommen Sie, Sie einen anderen Dienst, Service4, während der Hochlaufzeit für Service3 hinzufügen. In diesem Beispiel wird Service4 hinzugefügt, wenn der neue Parameter für die Serviceanfrage auf 40 festgelegt ist. Daher beginnt Service4 40 Anfragen pro Sekunde zu empfangen.

Die folgende Tabelle zeigt die Lastverteilung der Dienste während des in diesem Beispiel beschriebenen Zeitraums.

Tabelle 2. Lastverteilung auf Services beim manuellen Aufstieg der Last

| Rate der neuen Serviceanfrage = 10 Anforderungen/Sek. (Service3added) | Rate der neuen Serviceanfrage = 20 Anforderungen/Sek. | Rate der neuen Serviceanfrage = 40 Anforderungen/Sek. (Service4added) | Neue Serviceanforderungsrate = 0 req/sec (neue Dienste beenden langsamen Startmodus) | |

|---|---|---|---|---|

| Service1 | 115 | 110 | 80 | 60 |

| Service2 | 115 | 110 | 80 | 60 |

| Service3 | 10 | 20 | 40 | 60 |

| Service4 | - | - | 40 | 60 |

| Gesamte Req/sec (Last auf dem virtuellen Server) | 240 | 240 | 240 | 240 |

Automatischer langsamer Start

Wenn Sie möchten, dass die Appliance die Last eines neuen Dienstes automatisch in bestimmten Intervallen erhöht, bis der Dienst als fähig angesehen werden kann, seinen vollen Anteil der Last zu verarbeiten, legen Sie den neuen Parameter für die Serviceanfrage, den Einheitenparameter und das Inkrementintervall fest. Wenn alle Parameter auf andere Werte als 0 eingestellt sind, erhöht die Appliance die Belastung eines neuen Dienstes im angegebenen Intervall um den Wert der neuen Serviceanforderungsrate, bis der Dienst seinen vollen Anteil an der Last erhält.

Angenommen, vier Dienste, Service1, Service2, Service3 und Service4, sind an einen virtuellen Lastausgleichsserver vserver1 gebunden. Nehmen Sie ferner an, dass vserver1 100 Anforderungen pro Sekunde empfängt und die Last gleichmäßig auf die Dienste verteilt (25 Anforderungen pro Sekunde pro Dienst). Wenn Sie der Konfiguration einen fünften Dienst, Service5, hinzufügen, möchten Sie möglicherweise, dass die Appliance den neuen Dienst 4 Anforderungen pro Sekunde für die ersten 10 Sekunden, 8 Anforderungen pro Sekunde für die nächsten 10 Sekunden usw. sendet, bis 20 Anforderungen pro Sekunde empfangen wird. Für diese Anforderung zeigt die folgende Tabelle die Werte, auf die Sie die drei Parameter einstellen:

Tabelle 3. Parameterwerte

| Parameter | Wert |

|---|---|

| Intervall in Sekunden | 10 |

| Inkrementwert | 4 |

| Einheiten für die neue Serviceanforderungsrate | Anfragen pro Sekunde |

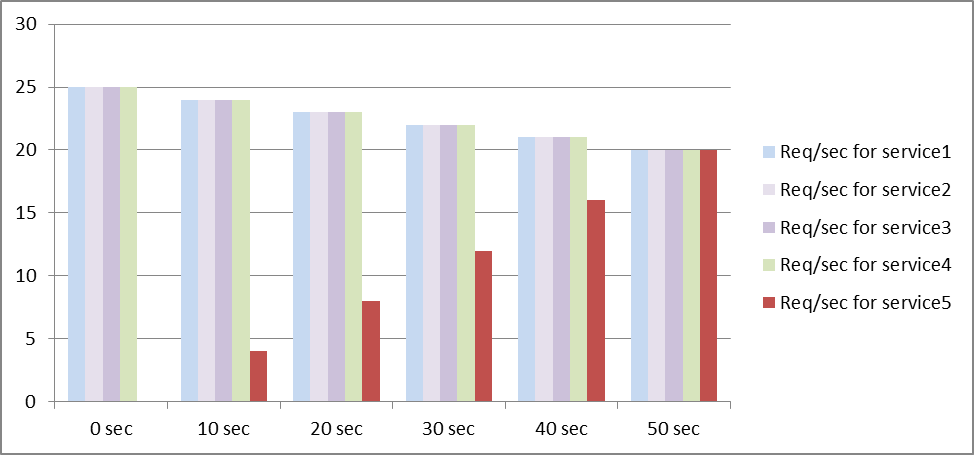

Mit dieser Konfiguration beginnt der neue Dienst 50 Sekunden, nachdem er hinzugefügt wurde oder sein Status von DOWN in UP geändert wurde, so viele Anforderungen wie die vorhandenen Dienste zu empfangen. Während jedes Intervalls in diesem Zeitraum verteilt die Appliance den Überschuss an Anforderungen, die ohne schrittweise Inkremente an den neuen Dienst gesendet worden wären, an die vorhandenen Server. In Ermangelung von schrittweisen Schritten hätte jeder Dienst, einschließlich Service5, 20 Anfragen pro Sekunde erhalten. In schrittweisen Schritten verteilt die Appliance während der ersten 10 Sekunden, wenn Service5 nur 4 Anforderungen pro Sekunde empfängt, den Überschuss von 16 Anforderungen pro Sekunde an die vorhandenen Dienste, was zu dem Verteilungsmuster in der folgenden Tabelle und Abbildung über den Zeitraum von 50 Sekunden führt. Nach der 50-Sekunden-Periode gilt Service5 nicht mehr als neuer Dienst und erhält seinen normalen Anteil am Verkehr.

Tabelle 4. Lastverteilungsmuster für alle Dienste für den 50-Sekunden-Zeitraum unmittelbar nach dem Hinzufügen von Service5

| 0 Sek. | 10 Sek. | 20 Sek. | 30 Sek. | 40 s | 50 s | |

|---|---|---|---|---|---|---|

| Anruf/Sek für Service1 | 25 | 24 | 23 | 22 | 21 | 20 |

| Anruf/Sek für Service2 | 25 | 24 | 23 | 22 | 21 | 20 |

| Anruf/Sek für Service3 | 25 | 24 | 23 | 22 | 21 | 20 |

| Anruf/Sek für Service4 | 25 | 24 | 23 | 22 | 21 | 20 |

| Anruf/Sek für Service5 | 0 | 4 | 8 | 12 | 16 | 20 |

| Gesamte Req/sec (Last auf dem virtuellen Server) | 100 | 100 | 100 | 100 | 100 | 100 |

Abbildung 1. Diagramm des Lastverteilungsmusters für alle Dienste für den 50-Sekunden-Zeitraum unmittelbar nach dem Hinzufügen von Service5

Eine alternative Anforderung besteht möglicherweise darin, dass die Appliance Service5 25% der Auslastung der vorhandenen Dienste in den ersten 5 Sekunden, 50% in den nächsten 5 Sekunden usw. sendet, bis 20 Anforderungen pro Sekunde empfangen wird. Für diese Anforderung zeigt die folgende Tabelle die Werte, auf die Sie die drei Parameter festlegen.

Tabelle 5. Parameterwerte

| Parameter | Wert |

|---|---|

| Intervall in Sekunden | 5 |

| Inkrementwert | 25 |

| Einheiten für die neue Serviceanforderungsrate | Prozent |

Mit dieser Konfiguration beginnt der Dienst 20 Sekunden, nachdem er hinzugefügt wurde oder sein Status von DOWN in UP geändert wurde, so viele Anforderungen wie die vorhandenen Dienste zu empfangen. Die Verkehrsverteilung während der Hochlaufzeit für den neuen Dienst ist identisch mit der zuvor beschriebenen, wobei die Einheit für die Schrittschritte “Anforderungen pro Sekunde” war.

Setze die Parameter für den langsamen Start

Sie legen die Parameter für den langsamen Start fest, indem Sie entweder den Befehl set lb vserver oder den add lb vserver Befehl verwenden. Der folgende Befehl dient zum Festlegen von langsamen Startparametern beim Hinzufügen eines virtuellen Servers.

So konfigurieren Sie stufenweise Lastinkremente für einen neuen Dienst mit der Befehlszeilenschnittstelle

Geben Sie an der Eingabeaufforderung die folgenden Befehle ein, um schrittweise Inkremente der Last für einen Dienst zu konfigurieren und die Konfiguration zu überprüfen:

add lb vserver <name> <serviceType> <IPAddress> <port> [-newServiceRequest <positive_integer>] [<newServiceRequestUnit>] [-newServiceRequestIncrementInterval <positive_integer>]

show lb vserver <name>

<!--NeedCopy-->

Beispiel

set lb vserver BR_LB -newServiceRequest 5 PER_SECOND -newServiceRequestIncrementInterval 10

Done

show lb vserver BR_LB

BR_LB (192.0.2.33:80) - HTTP Type: ADDRESS

State: UP

...

...

New Service Startup Request Rate: 5 PER_SECOND, Increment Interval: 10

...

...

Done

<!--NeedCopy-->

So konfigurieren Sie schrittweise Lastinkremente für einen neuen Dienst mit dem Konfigurationsdienstprogramm

- Navigieren Sie zu Traffic Management > Load Balancing > Virtuelle Server, und öffnen Sie einen virtuellen Server.

- Wählen Sie unter Erweiterte Einstellungen die Option Methode aus, und legen Sie die folgenden langsamen Startparameter fest:

- Rate der neuen Dienststartanforderung.

- Neue Serviceanforderungseinheit.

- Inkrementierungsintervall.

Teilen

Teilen

This Preview product documentation is Cloud Software Group Confidential.

You agree to hold this documentation confidential pursuant to the terms of your Cloud Software Group Beta/Tech Preview Agreement.

The development, release and timing of any features or functionality described in the Preview documentation remains at our sole discretion and are subject to change without notice or consultation.

The documentation is for informational purposes only and is not a commitment, promise or legal obligation to deliver any material, code or functionality and should not be relied upon in making Cloud Software Group product purchase decisions.

If you do not agree, select I DO NOT AGREE to exit.